预训练语言模型演进:从BERT、GPT到T5的统一理解

引言:从“手工作坊”到“基础模型”——NLP的范式革命

自然语言处理(NLP)的领域曾是一个“手工作坊”式的学科。研究者们为每个具体任务——情感分析、命名实体识别、机器翻译、问答系统——精心设计特定的模型架构,并在相对有限的标注数据集上进行训练。这种范式虽然催生了众多精巧的解决方案,但其局限性也日益明显:模型高度依赖任务特定的标注数据,泛化能力有限,且难以捕捉人类语言的深层、通用规律。

转变的种子在2017年随着Transformer架构的诞生而埋下。但真正的革命性突破发生在2018年及之后。以 BERT、GPT 和 T5 为代表的一系列预训练语言模型,彻底重塑了NLP的研究和应用范式。其核心思想可以概括为:在大规模无标注文本语料上,通过自监督任务进行预训练,获得通用的语言表示和世界知识;然后,通过轻量的微调或提示,将这种通用能力适配到下游的具体任务上。

这标志着NLP从“为每个任务制造专用工具”进入了“锻造一个多功能基础模型”的新时代。理解这场革命,不能仅停留在记住几个模型的名字,而需要厘清其背后的技术谱系:它们因何被提出?解决了什么根本问题?彼此间如何承袭与分化?又最终如何趋向统一?

本文将沿着时间线与逻辑线,深入剖析BERT、GPT(特别是GPT-3为代表)和T5这三大里程碑。我们将揭示,它们分别代表了基于Transformer的三种核心架构范式(编码器、解码器、编码器-解码器)与预训练目标,并最终共同指向了任务通用化和提示学习的未来。通过这一梳理,我们旨在为读者构建一幅清晰的NLP大模型技术演进地图。

第一部:BERT——双向编码与深度语境化的奠基

1.1 背景与核心突破:从单向到双向的语境理解

在BERT之前,基于语言模型的预训练(如ELMo、GPT-1)本质上是单向的。ELMo使用独立训练的前向和后向LSTM,简单拼接特征;GPT-1使用Transformer解码器,仅能基于上文预测下一个词。这种单向性限制了模型对词语在完整上下文中含义的理解。

BERT的核心创新在于:利用Transformer编码器,通过“掩码语言模型”任务,实现真正的深度双向语境编码。

掩码语言模型(MLM):

l 操作:随机掩盖输入序列中一定比例(如15%)的词语(替换为[MASK]特殊标记)。

l 任务:让模型基于被掩盖位置的双向上下文,预测被掩盖的原始词语。

l 意义:这迫使模型必须同时理解每个词左侧和右侧的全部信息,才能做出准确预测,从而学习到词语在具体语境下的动态表示。

下一句预测(NSP):

l 操作:将两个句子A和B拼接作为输入,其中50%的情况下B是A的实际下一句,50%的情况下B是随机选取的句子。

l 任务:让模型判断句子B是否为句子A的下一句。

l 意义:帮助模型理解句子间的关系,这对问答、自然语言推理等需要理解多个句子逻辑关系的任务至关重要。

1.2 模型架构与使用方式

BERT基于Transformer编码器堆栈。以BERT-Base为例,它包含12层编码器,隐藏层维度768,注意力头数12。

输入表示:BERT的输入是三个嵌入的求和:

l 词嵌入:将词语映射为向量。

l 段嵌入:用于区分两个句子(如句子A和句子B)。

l 位置嵌入:使用可学习的位置向量,编码词语在序列中的顺序。

微调范式:BERT的预训练-微调流程极为简洁高效。

l 预训练:在海量无标注文本(如BooksCorpus和英文维基百科)上进行MLM和NSP任务训练。

l 微调:对于下游任务(如文本分类、序列标注、问答),只需在预训练的BERT模型后添加一个简单的任务特定输出层(如一个分类器),然后使用下游任务的标注数据,对整个模型(包括BERT主体和新增输出层)进行端到端的微调。由于BERT已具备强大的通用语言理解能力,微调通常只需少量迭代和标注数据即可达到优异性能。

1.3 影响、局限与后续演进

划时代影响:

l 性能飞跃:BERT在GLUE、SQuAD等11项NLP基准测试上全面刷新纪录,提升幅度巨大。

l 范式确立:极大地普及和巩固了“预训练-微调”范式,证明了大规模预训练的巨大价值。

l 生态繁荣:催生了大量基于编码器架构的变体,如RoBERTa(移除NSP、动态掩码、更大批次与数据)、ALBERT(参数共享以减少参数量)、DistilBERT(知识蒸馏压缩模型)等。

核心局限:

l 非生成式:BERT作为编码器,天然适用于理解类任务,但不擅长文本生成。

l 预训练与微调任务的形式差距:MLM任务中引入的[MASK]标记在下游任务中并不存在,导致一定的预训练-微调差异。

l 自回归能力的缺失:无法像GPT那样进行流畅的序列生成。

BERT的成功,标志着基于双向编码器的理解型模型路线的成熟。

第二部:GPT系列——自回归生成与规模定律的探索

2.1 从GPT-1到GPT-3:坚持自回归生成之路

与BERT选择编码器和MLM任务不同,GPT系列自始至终坚持使用Transformer解码器架构和标准的自左向右语言模型预训练目标。

核心思想:给定一个文本序列 ( x_1, x_2, …, x_{t-1} ),预测下一个词 ( x_t ) 的概率分布 ( P(x_t | x_1, …, x_{t-1}) )。这个目标被称为自回归语言建模。

架构特点:使用Transformer解码器,其核心是掩码自注意力。在计算当前位置的注意力时,只能看到它之前的位置,无法看到之后的位置,从而保证生成过程的自回归特性。

演进历程:

l GPT-1:初步证明了在无标注数据上预训练语言模型,再微调下游任务的有效性,但模型规模和数据量相对较小。

l GPT-2:显著扩大模型规模(最大15亿参数)和训练数据,并强调其零样本学习能力——即在不进行任务特定微调的情况下,仅通过提供任务描述或示例(提示),模型就能直接执行翻译、摘要、问答等任务。这揭示了大规模语言模型蕴含的“任务通用”潜力。

l GPT-3:将规模和数据推到前所未有的高度(1750亿参数,数千亿token)。其核心论文《Language Models are Few-Shot Learners》系统论证了规模定律:随着模型参数、训练数据和计算量的指数级增长,模型性能会平滑提升,并且在少样本、零样本学习能力上出现质的飞跃。GPT-3展示了仅通过精心设计的提示,而无需更新模型参数(即上下文学习),就能完成复杂任务。

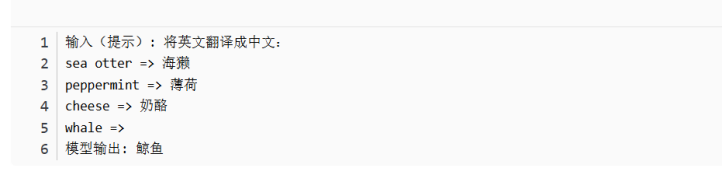

2.2 上下文学习与提示范式

GPT-3最重要的贡献之一是让“提示”成为与“微调”并列的、使用大模型的核心范式

l 微调:更新模型参数以适应任务。

l 提示(上下文学习):不更新参数,而是在输入中嵌入任务指令和/或少量示例,让模型根据上下文生成答案。

这种能力意味着,模型将庞大的预训练知识存储在其参数中,并能根据输入的“提示”进行灵活的任务适配和知识调用。这极大降低了应用门槛,并催生了提示工程这一新领域。

2.3 影响与通向ChatGPT

影响:

l 验证规模定律:GPT-3强有力地证明了扩大模型规模是提升性能的有效途径,掀起了“大模型”竞赛。

l 推动提示范式:使NLP应用模式从“训练一个模型”向“编写一个提示”转变。

l 通向通用人工智能的猜想:其涌现出的强大能力,引发了关于“通过纯文本预测下一个词的目标,是否足以产生通用智能”的深刻讨论。

局限与挑战:

l 事实性与幻觉:模型可能生成流畅但不符合事实的内容。

l 可控性与安全性:难以精确控制生成内容的有害性、偏见或风格。

l 理解复杂指令:对于嵌套、多步骤的复杂指令,原始GPT-3容易出错。

这些局限正是后续工作(如ChatGPT)试图通过指令微调和基于人类反馈的强化学习来解决的方向。GPT系列奠定的自回归生成模型路线,最终与人类对齐技术结合,催生了对话式AI的突破。

第三部:T5——“文本到文本”的统一框架

在BERT和GPT分别引领理解和生成风潮之后,谷歌于2019年提出了 T5 模型。T5的野心更大:探索统一的预训练框架,用一个模型解决所有NLP问题。

3.1 核心思想:万物皆可文本到文本

T5提出将所有NLP任务都重新格式化为一个统一的 “文本到文本” 任务。

l 输入:一段文本(其中可以包含任务描述)。

l 输出:另一段文本。

举例:

l 翻译:输入:“translate English to German: That is good.” 输出:“Das ist gut.”

l 分类:输入:“cola sentence: The course is jumping well.” 输出:“not acceptable”

l 摘要:输入:“summarize: state authorities dispatched emergency crews tuesday to survey the damage after an onslaught of severe weather in mississippi.” 输出:“damage surveyed after severe weather in mississippi”

这意味着,T5模型在预训练和微调阶段,看到的是同一种形式的任务:接收一段文本,生成另一段文本。它采用了完整的Transformer编码器-解码器架构。

3.2 大规模系统化探索

T5工作的另一大贡献是进行了可能是NLP史上最系统、最昂贵的对照实验。研究者们在庞大的计算集群上,系统比较了:

l 不同预训练目标:如BERT式的MLM、GPT式的LM、去噪目标(类似BART)等。最终发现,简单的Span Corruption(随机遮盖一个连续的文本段,然后让模型重建该段)效果最佳。

l 不同的无监督数据集、模型规模、训练策略。

l 统一微调:所有下游任务都转化为文本到文本格式,使用相同的损失函数和训练流程进行多任务微调。

3.3 意义与影响

l 架构统一:证明了编码器-解码器架构是一个强大的通用容器,既能理解(编码器)又能生成(解码器)。

l 任务形式统一:文本到文本框架极大简化了多任务学习的复杂性,为构建多任务、通用的NLP模型提供了清晰蓝图。

l 方法论贡献:其大规模系统实验为社区提供了宝贵的经验数据,指导了后续模型设计。

T5可以被视为在统一框架道路上的一个里程碑。它启示我们,不同的NLP任务或许并非本质不同,而只是对同一核心能力(文本转换)的不同表现形式。

第四部:统一视角下的技术谱系

通过对BERT、GPT、T5的深入分析,我们可以从几个维度绘制出预训练语言模型的技术谱系图,并理解它们的内在联系与演进方向。

4.1 架构、预训练任务与能力对比

4.2 演进的主线与融合趋势

看似三条分立的路线,实则存在清晰的演进与融合逻辑:

1. 从“理解”与“生成”分立走向“统一”:

l 早期:BERT(强理解,弱生成)和GPT(强生成,弱理解)各擅胜场。

l 发展:T5用编码器-解码器架构试图统一二者。后续模型如BART(编码器-解码器, 去噪预训练)也属于此路线。

l 现状:解码器架构的生成模型(如GPT-3/4),通过规模的扩大和提示工程,展现出了惊人的理解能力,事实上在Many任务上模糊了理解与生成的界限。而理解模型通过引入类似生成任务(如Span Prediction)也能获得一定生成能力。

2. 从“微调”到“提示”再到“指令微调”:

l BERT时代:微调是主流,模型被动适应任务。

l GPT-3时代:提示(上下文学习)兴起,模型根据指令主动适配。

l ChatGPT/InstructGPT时代:指令微调成为关键。先用人类编写的指令-输出对微调模型,使其更好地遵循指令,再使用基于人类反馈的强化学习(RLHF)进一步对齐人类偏好。这标志着从“任务性能优化”到“人机交互与价值观对齐”的深刻转变。

扫一扫,关注我们