目标检测系列之YOLOv12——融入注意力机制

前言:在目标检测领域,YOLO 系列一直以 “速度与精度的平衡” 著称,但长期以来,其架构优化始终围绕 CNN 展开。尽管注意力机制在建模能力上早已被证明优于 CNN,却因计算复杂度高、内存访问低效等问题,难以融入实时检测场景。而 YOLOv12 的横空出世,彻底打破了这一僵局 —— 它以注意力为核心重构 YOLO 框架,在保持 CNN 级推理速度的同时,实现了精度的跨越式提升。

一、研究背景

在 YOLOv12 之前,主流实时检测器面临一个核心矛盾:注意力机制的强建模能力与实时检测的高效需求不兼容。具体来说:

1. 计算复杂度矛盾:自注意力的计算量随输入序列长度呈二次增长(O(L2d)),而 CNN 仅为线性增长(O(kLd)),当处理 640×640 分辨率图像时,注意力的计算成本会急剧上升;

2. 内存访问矛盾:注意力计算中,中间特征图(如QKT矩阵)需要在 GPU 高速缓存(SRAM)和显存(HBM)间频繁读写,而 CNN 的滑动窗口操作具有结构化内存访问优势, latency 更低;

3. 架构适配矛盾:现有注意力模型(如 ViT、Swin Transformer)的复杂设计(如窗口划分、位置编码)会累积速度开销,难以适配 YOLO 的轻量化需求。

YOLOv12 的核心目标的就是解决上述问题:构建一个以注意力为核心,同时满足实时性要求的 YOLO 框架,让注意力的建模优势与 YOLO 的高效推理结合。

二、YOLOv12 的核心创新方法

为实现 “注意力 + 实时性” 的双重目标,YOLOv12 提出了三大关键技术:Area Attention(区域注意力)、R-ELAN(残差高效层聚合网络)和针对性的架构优化。三者协同作用,从计算效率、优化稳定性、系统适配性三个维度破解注意力机制的落地难题。

1. Area Attention:简单高效的注意力降维方案

传统注意力的核心痛点是 “全局计算成本过高”,而局部注意力(如 Swin 的移位窗口、轴向注意力)虽能降低复杂度,却引入了窗口划分 / 合并的额外开销,还可能缩小感受野。YOLOv12 提出的Area Attention(A²),用最简洁的设计实现了 “降复杂度 + 保感受野” 的双赢。

核心设计思路

Area Attention 的核心是 “无开销区域分割”:将输入特征图(H×W)沿水平或垂直方向均匀分割为l个区域(默认l=4),每个区域内进行局部注意力计算。例如,将640×640的特征图分割为 4 个160×640的长条区域,每个区域内的注意力计算量仅为全局的1/4。

关键优势

l 计算复杂度骤降:无需复杂的窗口划分逻辑,仅通过简单的 reshape 操作即可实现区域分割,将注意力计算量从2n2hd降至1/2n2hd(n为 token 数);

l 保留大感受野:尽管分割后每个区域的感受野仅为全局的1/4,但相较于 CNN 的固定卷积核,仍能捕捉更广泛的上下文信息,对大目标检测更友好;

l 速度无损耗:避免了窗口注意力的移位、合并等额外操作,推理速度与 CNN 模块几乎持平。

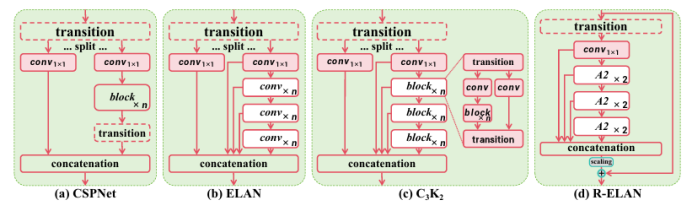

2. R-ELAN:解决注意力模型的优化难题

当 YOLO 的骨干网络替换为注意力模块后,新的问题出现了:大尺度模型(L/X 级)难以收敛,甚至出现梯度阻塞。这是因为传统的 ELAN(高效层聚合网络)缺乏输入到输出的残差连接,且特征聚合方式存在不稳定性。YOLOv12 提出的R-ELAN(残差高效层聚合网络),通过两大改进解决了这一问题。

改进点 1:块级残差设计 + 缩放技术

在 ELAN 的基础上,R-ELAN 引入了从输入到输出的残差捷径,并添加了一个缩放因子(默认 0.01)。这一设计借鉴了层缩放(Layer Scaling)的思想,但避免了对每个注意力模块单独缩放带来的速度损耗。

l 作用:残差连接缓解了深度网络的梯度消失问题,而缩放因子则平衡了残差路径与主路径的特征贡献,让大尺度模型(如 YOLOv12-X)能够稳定收敛;

l 实验验证:没有残差连接时,YOLOv12-X 无法收敛;加入缩放因子 0.01 后,mAP 达到 55.2%,且训练过程无波动。

改进点 2:重构特征聚合方式

传统 ELAN 的特征聚合流程为:输入→1×1 卷积降维→分割为两部分→一部分经多模块处理→拼接输出。这种方式存在 “特征冗余” 和 “计算浪费”。

R-ELAN 的聚合流程优化为:输入→1×1 卷积调整通道→单路径多模块处理→拼接聚合→输出。核心变化是:

l 移除了 “特征分割” 步骤,避免了冗余计算;

l 采用 “瓶颈结构” 聚合特征,在保持特征表达能力的同时,减少了 FLOPs 和参数量;

l 实验验证:与 ELAN 相比,R-ELAN 在 mAP 基本持平的情况下,参数量减少 10% 以上, latency 降低约 8%。

3. 架构级优化:让注意力完美适配 YOLO

除了核心模块创新,YOLOv12 还对注意力架构进行了一系列 “轻量化适配”,确保其能融入 YOLO 的实时检测流水线。这些优化看似细节,却直接决定了模型的速度上限:

(1)引入 FlashAttention 解决内存访问问题

注意力机制的另一个核心痛点是 “内存访问低效”—— 中间特征图的频繁读写会导致大量 latency。YOLOv12 直接集成了 FlashAttention,通过 I/O 优化减少内存访问开销,让注意力计算的实际速度提升 30% 以上。

(2)移除位置编码,用 “位置感知器” 替代

传统 ViT 依赖位置编码(PE)提供位置信息,但这会增加计算量和模型复杂度。YOLOv12 的创新在于:

l 直接移除位置编码,让架构更简洁;

l 引入7×7 大核可分离卷积(位置感知器),通过卷积的空间感应能力,帮助注意力模块捕捉位置信息;

l 实验验证:无位置编码 + 7×7 卷积的组合,比传统 APE/RPE 方案 mAP 提升 0.3%, latency 降低 4%。

(3)调整 MLP 比例,平衡注意力与 FFN

传统 ViT 中,注意力模块后的 MLP 比例(隐藏层维度 / 输入维度)通常设为 4,这会导致 FFN 部分占用大量计算资源。YOLOv12 根据 YOLO 的检测任务特性,将 MLP 比例调整为 1.2(N/S/M 级模型为 2.0),让计算资源更倾向于注意力模块。

l 作用:减少 FFN 的冗余计算,同时强化注意力的特征建模能力;

l 实验验证:MLP 比例从 4.0 降至 1.2 后, latency 降低 12%,mAP 提升 0.7%。

(4)保留层级化设计,简化骨干网络

与 ViT 的 “扁平架构” 不同,YOLOv12 保留了 YOLO 系列经典的层级化设计(多尺度特征融合),并对骨干网络进行简化:

l 移除了 YOLOv11 中最后阶段的 3 个堆叠块,仅保留 1 个 R-ELAN 块,减少模型深度;

l 前两阶段沿用 YOLOv11 的 C3K2 模块,避免过度重构带来的适配成本;

l 用 Conv2d+BN 替代 Linear+LN,充分利用卷积的硬件加速优势。

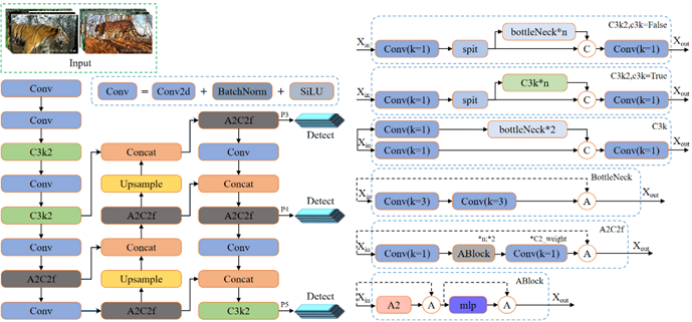

4.整体网络架构

1. Backbone(骨干网络):输入图像(左侧 “Input”)经 Conv、C3k2、A²CF 模块,逐步下采样提取大、中、小 3 种尺度的特征图(对应不同语义层级);

2. Neck(颈部特征融合):通过 “Upsample(上采样)+ Concat(拼接)” 融合 Backbone 输出的 “高层高语义特征” 与 “低层高细节特征”(FPN+PAN 结构),增强不同尺度目标的特征表达;

3. Head(检测头):3 个 “Detect” 模块分别对应 3 种尺度的融合特征图,输出不同尺寸目标的类别、框坐标等检测结果。

三、总结与展望

YOLOv12 的核心贡献,不仅是提出了几个高效的注意力模块,更重要的是构建了一套 “注意力友好” 的实时检测框架—— 它证明了注意力机制并非实时检测的 “负担”,只要通过合理的架构设计和工程优化,就能让其成为精度提升的 “核心动力”。其主要的意义在于:

1. 复杂问题简单化:Area Attention 用 “均匀分割” 替代复杂的窗口机制,R-ELAN 用 “残差 + 瓶颈聚合” 解决优化问题,避免了过度设计;

2. 任务适配优先:所有架构优化都围绕 YOLO 的 “实时性” 需求,而非盲目追求注意力的理论优越性;

3. 工程与算法协同:FlashAttention 的集成、卷积与注意力的混合使用,体现了 “算法创新 + 工程优化” 的双重价值。

扫一扫,关注我们